США начнут тестировать новые ИИ-модели Google, Microsoft и xAI до их публичного выпуска

Google, Microsoft и xAI добровольно отдают свои ИИ-модели на тестирование Министерству торговли США

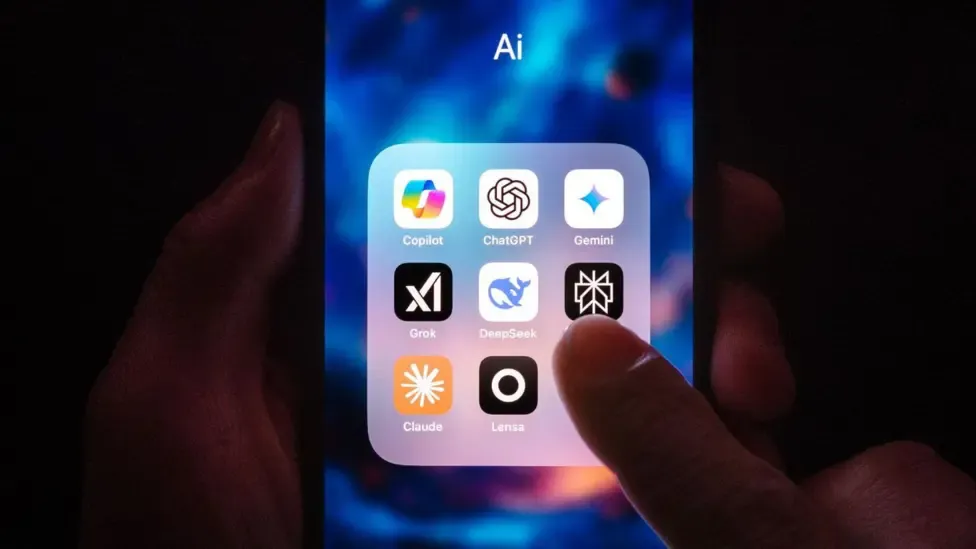

Новые инструменты и возможности искусственного интеллекта от Google, Microsoft и xAI теперь будут проходить проверку в Министерстве торговли США до того, как попадут в открытый доступ. Технологические компании согласились добровольно предоставлять свои модели для тестирования в Центре стандартов и инноваций в области ИИ (CAISI). Новые соглашения расширяют договорённости с OpenAI и Anthropic, достигнутые ещё при администрации Байдена. Теперь модели всех этих компаний будут оцениваться на предмет их возможностей и безопасности.

«Эти расширенные отраслевые коллаборации помогают нам масштабировать нашу работу в общественных интересах в критический момент», — заявил директор CAISI Крис Фолл. В целом оценка ИИ-инструментов будет охватывать «тестирование, совместные исследования и разработку лучших практик, связанных с коммерческими ИИ-системами».

Какие именно модели будут проверять

Самый известный ИИ-инструмент Google через его дочернюю компанию DeepMind — это Gemini, чат-бот, широко доступный в продуктах Google, но теперь используемый также в оборонных и военных ведомствах США. Самый известный инструмент Microsoft — CoPilot. Единственный ИИ-продукт xAI — это Grok, чат-бот, который уже привлекал широкое общественное внимание из-за проблем, связанных с генерацией изображений, где он «раздевал» людей.

Во вторник CAISI сообщил, что провёл 40 предыдущих оценок ИИ-инструментов, включая оценку и тестирование некоторых «передовых моделей, которые остаются невыпущенными». Центр не уточнил, какие именно модели были остановлены от выхода в публичный доступ.

Реакция компаний

В корпоративном блоге после объявления CAISI компания Microsoft заявила, что уже тестирует свои ИИ-модели, но «тестирование на предмет национальной безопасности и крупномасштабных общественных рисков обязательно должно быть совместной задачей с правительствами». Представительница Google DeepMind отказалась от комментариев. Представитель SpaceX (компании Илона Маска, которая теперь контролирует xAI) не ответил на запрос.

Смена курса Белого дома

Привлечение большего числа компаний к исследованиям и тестированию безопасности коммерческих ИИ-инструментов знаменует отход от прежнего курса администрации Трампа, которая в основном придерживалась невмешательства в надзор или регулирование ИИ и технологических компаний. В прошлом году президент Дональд Трамп подписал серию указов, которые легли в основу его «Плана действий в области ИИ». Трамп тогда заявлял, что план «уберет бюрократические препоны и обременительные регуляции» и обеспечит США победу через advancements и контроль над технологией.

Однако, судя по всему, Белый дом меняет свою позицию. Причины — расширение использования ИИ американскими военными, а также недавние заявления Anthropic о том, что компания разработала модель под названием Mythos (слишком мощную для публичного выпуска). Как ранее сообщала BBC, высокопоставленные сотрудники администрации Трампа встречались в прошлом месяце с генеральным директором Anthropic Дарио Амодеи — несмотря на то, что компания сейчас находится в судебном процессе с Министерством обороны США из-за отказа Anthropic убрать защитные ограничения для правительственного использования своих моделей.

Ключевые факты

- Тестирующие: Министерство торговли США (Центр CAISI)

- Участники: Google (DeepMind) — Gemini, Microsoft — CoPilot, xAI — Grok, а также ранее OpenAI и Anthropic

- Формат: добровольное предоставление моделей для тестирования до публичного выпуска

- Что проверяется: возможности модели, безопасность, риски национальной безопасности и общественной безопасности

- Предыдущий опыт CAISI: 40 оценок, включая модели, которые так и не были выпущены (какие именно — не раскрывается)

- Контекст: смена курса — от дерегулирования при Трампе к более активному участию государства (частично из-за военных применений ИИ и случаев с «опасно мощными» моделями)

- Судебный фон: Anthropic судится с Минобороны США из-за отказа убирать защитные механизмы для госзаказчиков

Сравнение подходов двух администраций

| Аспект | Администрация Байдена | Администрация Трампа (до недавнего времени) | Текущий курс |

|---|---|---|---|

| Отношение к регулированию ИИ | Активное привлечение компаний к добровольному тестированию (OpenAI, Anthropic) | «Убрать регуляции», «США должны победить», красный ковёр для индустрии | Расширение тестирования (Google, Microsoft, xAI) — фактически продолжение линии Байдена, но под другим флагом |

| Военное использование ИИ | Осторожное | Расширяется | Расширяется, что и подталкивает к тестированию |

Итог: Администрация Трампа, которая пришла к власти под лозунгом дерегулирования, теперь вынуждена ужесточать контроль над ИИ — по крайней мере в форме добровольного тестирования. Причины: военные сами активно внедряют ИИ, а компании (как Anthropic) начинают выпускать модели, которые считают слишком опасными для публики. В итоге Белый дом движется в ту же сторону, что и администрация Байдена, — просто с другим слоганом. А компании, включая xAI Илона Маска, соглашаются на тесты, потому что альтернатива (жёсткое регулирование) им нравится ещё меньше.

ДРУГИЕ СТАТЬИ

29.05.2026

BMW запускает человекоподобных роботов: почему колёса лучше ног на заводском полу

Впервые в Европе BMW будет использовать человекоподобных роботов для производства автомобилей. Два робота, созданных компанией Hexagon Robotics, планируют запустить в производство летом. Сейчас они проходят тестовую эксплуатацию на заводе в Лейпциге. «Это будущее автомобильного производства», — говорит Михаэль Николаидес, руководитель отдела управления процессами и цифровизации BMW.

Роботизированные руки и другая автоматизация используются в автопроме десятилети

28.05.2026

Инженер Google по информационной безопасности арестован за инсайдерские ставки на $1,2 млн

Сотрудник Google был арестован за использование внутренней информации компании для успешных ставок на платформе прогнозов Polymarket. Прокуратура Южного округа Нью-Йорка предъявила инженеру Google Микеле Спаньоло обвинение в нарушении законов об инсайдерской торговле из-за нескольких ставок, сделанных через платформу. Хотя Спаньоло — гражданин Италии, проживающий в Швейцарии, он был арестован в среду и доставлен к федеральному судье в Нью-Йорке.

По версии обви�

27.05.2026

Чемпионка по этичному взлому предупреждает: ИИ-инструменты вроде Mythos могут оставить её без работы

«Zombie hacker mode» против ИИ: чемпионка по взлому боится, что её дни сочтены

Этичный хакер, которая только что выиграла крупные призы на престижном международном соревновании, предупреждает: дни её участия в конкурсах могут быть сочтены из-за появления таких ИИ-инструментов, как Claude Mythos. Валентина Пальмиотти (более известная как Chompie) стала самой успешной участницей ежегодного конкурса по взлому Pwn2Own в Берлине. В интервью BBC она рассказала, что пока ИИ-инструменты помогают ей выигрывать «баг-баунти» — вознаграждения за обнаружение уязвимостей в о�

26.05.2026

Врачи сравнили вред соцсетей для подростков с курением. Правительство рассматривает запрет

По мнению ведущих врачей Великобритании, использование социальных сетей наносит здоровью молодых людей такой же вред, как курение. В своём обращении к правительственной консультации по использованию соцсетей для детей до 16 лет Академия медицинских королевских колледжей предлагает медикам регулярно спрашивать юных пациентов о времени, проведённом в интернете и соцсетях. При этом в научном сообществе до сих пор нет единого мнения о том, что экранн

ПИШИТЕ

Техническая поддержка проекта ВсеТут